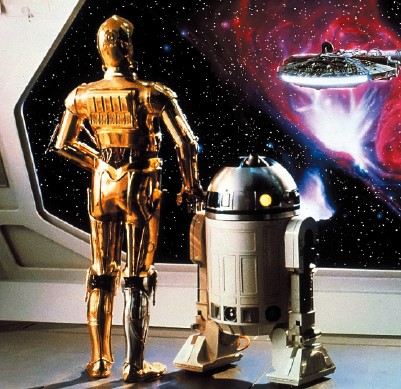

说到机器人,我们都非常熟悉。《星球大战》中的阿图(R2-D2)和C-3PO、变形金刚、终结者、瓦力(WALL-E)……科幻大片里的机器人往往无所不能,在智能上也和人类没有太大的区别。但现实社会中真正的机器人,目前已经具有什么样的能力?真正拥有一个可以与我们交流、合作的机器人伙伴的日子还远吗?

到底什么是机器人?

你有没有仔细想过,机器人到底是什么?它们和我们日常使用的各种机器设备有什么不一样?和人又有何不同?

关于什么是机器人(Robot),存在着多种定义,研究者们尚未达成一致意见。一些能表现出人类或其他生物的某些特征的机器装置,都会被我们称作机器人。例如商场门口会抬手打招呼的机械模特,或是能识别主人声音的宠物机器狗等。

机器人可以分为两大类。一类是传统机器人,它们具有执行程序指令和操作物理对象的能力。这类机器人一般只能在特定的环境中重复执行相对简单的固定动作,例如汽车生产流水线上的工业机器人(机械臂)。另一类就是“智能机器人”,它们更像我们人类,能够在未知的、不断变化的和难以预测的环境中行动、工作。智能机器人的本领比传统机器人要强得多,它们能感知识别环境的状态,能根据获得的信息进行推理和规划,然后采取适当的行动完成任务。也就是说,智能机器人需要具备感觉、决策和行动这三个要素。

中国科技大学的机器人“可佳”,属于“智能服务机器人”,这是机器人家族中的一个年轻成员。服务机器人的最大特点就是人机互动,也就是人和机器人之间存在互动和交流,而不仅仅是简单地通过接受程序指令完成某项任务。要实现复杂的人机互动,就要求机器人具有更高的感知、行动和决策能力。例如,很多传统机器人不具备物体识别能力也能完成任务,而服务机器人则不但要能够识别环境中的各种物体,甚至还需要能认出生命体,特别是人。与非生命体相比,人的外形特征和行为复杂多变,这就给机器人的感知带来巨大的挑战。

人与非生命体的一个本质区别是,人是有意愿的,而满足人的某些意愿正是服务机器人的根本目的。用简单命令词表达少数命令,虽然也体现了人类的一部分意愿,但这远远不能满足我们的需求。我们最希望机器人具有的能力就是,它能像一个真正的人一样与我们互动,能理解我们用自然语言表达的各种意愿,并能帮助我们实现这些意愿。这种能力是对智能服务机器人的最大挑战之一。

《星球大战》中著名的机器人R2-D2和C-3PO是人类的忠实伙伴,它们都属于智能服务机器人。

机器人的“智能”

目前,机器人与人的差别主要体现在体力和智力两个方面。首先,在躯体的灵活性、适应性等方面,机器人与人存在很大的差距,比如现在的机器人还难以完成需要复杂躯体动作的行为。不过近年来,著名的美国波士顿动力学公司(Boston Dynamics)的一种机器人硬件平台PETMAN取得了突破性进展,使得机器人在躯体运动方面与人的差距大为缩小。随着机器人在躯体运动能力方面的迅速进步,机器人与人的差别将主要体现在智能方面。

那么,智能又是什么?不得不说,智能也是一个至今没有公认标准定义的概念。不过,一般认为,语言、推理、规划、学习等能力是智能中非常重要的成分,而感知、记忆、运动能力中也隐含着不同程度的智能。研究发现,一些看似简单的运动,如果要达到比较高的水准,往往也需要运动者具有较高的智能。

当然,目前机器人的“思考”能力还远远不能与人类相比。人类的思考是一种多层面、全方位的神经与心理过程,我们人类可以综合地运用各种各样的“运算”方式:可以是形象的,也可以是抽象的;可以是语言型的,也可以是非语言型的;可以是严格计算、推理的,也可以是“凭直觉”的;既有显意识层面的,也有潜意识层面的……人类的思维过程实在太复杂,至今依然没有被我们自己认识清楚。所以,想要通过完全模拟人类自己的思维过程,使机器人具有类似人类的智能,目前还不可能。

那么在我们没有研究清楚人类大脑思维的奥秘之前,是不是就不能开发出具有一定智能的机器人呢?也并非如此。科学家将语言、推理、规划、学习等人类思维的某些方面,从人的整体思维过程中抽象出来,当做一个个独立的对象加以研究,发现了很多思维的规律和机制。所以,在某些特定的场合中,独立地运用某些人工智能技术,已经可以达到很高的水准。比如说,对于一个自己不熟悉的抽象规划问题,普通人往往最多可以计算十几步,而计算机运用规划算法则可以轻易地计算几十步甚至几百步。早在1997年的那场著名的国际象棋人机大战中,IBM的超级电脑“深蓝”就凭借高超的搜索和计算能力,首次击败了人类的世界冠军卡斯帕罗夫。

在“可佳工程”中,机器人智能的研究主要包括了4个方面:一是语义理解,也就是让机器人能理解包括英语、汉语在内的一些自然语言短语和句子,这样机器人就能通过人机对话来理解人的指令和需求;二是环境建模,也就是让机器人能够观察、识别外在环境,并建立外部环境的内部模型;三是自动规划,这是指机器人的行为不仅仅局限于对外界刺激的简单的、被动的反应,而是能够通过主动的规划来确定行动步骤;四是学习能力,让机器人通过多种学习手段获取新技能和新知识,从而不断提高自身的能力。

认出看到的东西并不简单

人类是通过眼睛、耳朵、鼻子、皮肤等器官感知外界信号的。类似地,机器人也是通过各种传感器来感知自己所处的外界环境的状态,这些传感器包括摄像机和激光测距仪(眼睛)、麦克风(耳朵)、压力传感器(皮肤)等等。人类的感觉器官获取的信号,被传输到大脑皮层,在不同的功能区进行分析处理;而机器人的每一种传感器,也都有一个对应的软件与之相配套,专门分析处理这个传感器收集到的信息,将原始的光电数据转换为视觉、听觉、触觉等感知信息。

“可佳”头部的两个摄像机就是它的眼睛,它能够对看到的图像进行分析,识别环境中的人和各类物体。“可佳”能够通过人脸的不同,认出并记住不同的人。它还可以检测、区分不同的物体,并确定它们的位置,从而指挥自己身上的机械手抓取物体。

“可佳”有两套视觉系统。一套是传统的视觉识别系统,它首先获取物体的形状、大小、颜色和纹理等特征,然后将看到的对象与模型数据库中的物体模型进行比较,根据相似度来判断看到的物体是什么。如果某个物体被部分遮挡了,而未被遮挡的部分与模型的相似度足够高,且与其他物体的差别足够大,“可佳”也可以判断出这个物体的类别。另一套视觉识别系统则不依赖于模型库,而是根据物体的特征,利用有关知识来分析、推断物体的类别。这套系统在识别被遮挡物体方面具有更大的潜力。

综合这些信息,机器人就可以对自己所处的环境建立起一种“内部模型”。这种内部模型就好象是外部环境在机器人“大脑”中的“映像”。智能机器人的决策系统能够根据这个内部模型,“判断”环境的状况,甚至还可以“猜测”环境可能发生的变化。有了对环境的判断,机器人接下来就会根据大脑(计算机)中掌握的有关知识,决定自己下一步如何行动。

(本文发表于《科学世界》2013年第11期)

请 登录 发表评论